AI的逻辑、原理、应用与局限分别是?

人工智能(AI)正逐渐渗透到我们的生活和工作中:智能手机里的语音助手、网购推荐系统、自动驾驶辅助、医疗诊断系统、金融风控工具……几乎无处不在。然而,公众对 AI 的认知仍存在误区:有人认为它无所不能,有人担心它会取代人类。事实上,AI 的能力和局限完全取决于数据、算法和训练方式。理解这些,才能既合理使用 AI,又避免盲目恐慌。

本文将从逻辑、原理、数据与算法、训练方法、大模型、应用场景、算法局限、人工智障案例、公众教育等方面,系统讲解 AI,让公众理解 AI 的本质与应用。

一、AI 的逻辑:模式识别而非思考

AI 并不具有意识,它的“智能”本质上是模式识别和概率推理。

图像识别例子:你给 AI 大量猫和狗的照片,它会学会区分两者的特征(如耳朵形状、毛发纹理)。给它一张新照片,它会根据已学规律判断这是猫还是狗。

文字生成例子:大语言模型(LLM)学习大量文本,捕捉句式、语义和逻辑关联。收到提示后,它根据训练规律生成符合上下文的文字。

核心逻辑:AI 的“判断”源自数据规律,而非理解或意识。

二、数据:AI 的根基

2.1 数据类型与作用

大数据:海量、多样化的信息(如全网用户行为),适合训练通用模型。

局部或有限的数据(如某医院的病例),适合特定场景,但泛化能力有限。

结构化数据与非结构化数据:表格、传感器数据属于结构化;文字、图片、音视频属于非结构化。

2.2 数据质量决定结果

高质量数据:准确、全面、标注清晰 → AI 可靠。

低质量数据:错误、缺失、不均衡 → AI 判断失误甚至产生偏差。

2.3 “垃圾进垃圾出”(GIGO)

如果训练数据错误或偏差,无论算法多么先进,AI 输出也会是错误的或低质量的——俗称“人工智障”。

案例:自动驾驶系统,如果训练数据中缺少雨雪、夜间或复杂道路场景,AI 可能在实际道路上做出危险判断。

三、算法:数据的处理与放大器

数据决定 AI 能学到什么,算法决定 AI 如何学习并应用数据。

3.1 算法选择

不同算法适合不同任务:

图像识别:卷积神经网络(CNN)优于传统特征工程方法。

文本处理:Transformer 架构大幅提升语言理解与生成能力。

回归、随机森林、梯度提升树等各有适用场景。

3.2 算法训练过程

训练包括:

数据预处理与清洗

数据增强与特征提取

模型参数调优与正则化

训练不当会导致:

过拟合:模型在训练数据上表现很好,但新数据上失败。

欠拟合:模型无法捕捉规律,表现不佳。

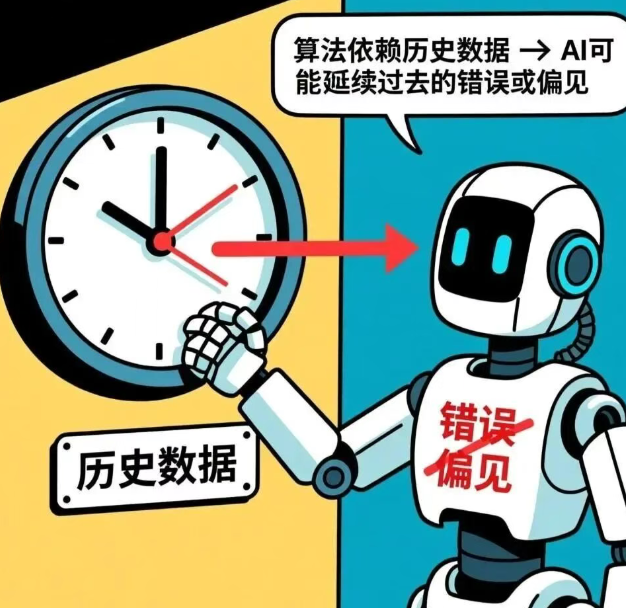

3.3 算法局限(假设 X → Y 形式)

假设训练数据存在偏差 → AI 输出可能不公平或歧视

假设训练数据不足或缺乏多样性 → AI 无法应对复杂场景

假设模型复杂但不可解释 → 人类难以理解决策原因

假设算法依赖历史数据 → AI 可能延续过去的错误或偏见

假设任务超出算法能力 → AI 输出可能荒谬或错误

总结:算法再强,也离不开高质量、多样化数据,同时受限于设计和训练假设。

四、训练与大模型

4.1 训练的重要性

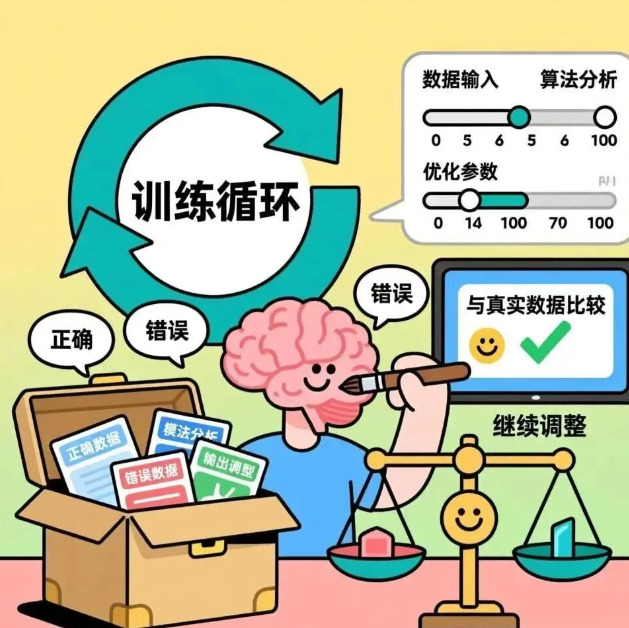

训练过程是 AI 学习规律的核心:

数据输入 → 算法分析

模型调整 → 优化参数

输出预测或生成结果 → 与真实数据比较,继续调整

每轮训练都依赖数据质量和算法设计,错误数据会被“放大”,形成错误认知。

4.2 大模型(LLM)特点

参数量巨大,通常数百亿到千亿级

可处理多种任务:文本生成、图像理解、跨领域推理

高性能算力和海量数据是支撑

局限:高成本、可解释性低、对训练数据依赖强

五、AI 应用场景与案例分析

5.1 医疗健康

应用:影像诊断、辅助决策、药物研发

案例:某医院 AI 诊断系统识别肺结节成功率高,但在训练集中缺乏老年病例 → 老年患者误诊率高

5.2 金融风控

应用:信用评估、欺诈检测

风险:数据偏差导致特定群体贷款审批不公

5.3 教育学习

应用:个性化学习、智能辅导

局限:数据不足或不均衡 → 对部分学生群体效果差

5.4 自动驾驶与工业生产

应用:智能工厂、自动驾驶辅助

风险:训练数据无法覆盖所有极端场景 → 可能导致事故

5.5 日常生活

推荐系统、语音助手、内容生成

数据偏差可能形成“信息茧房”,加深认知偏差

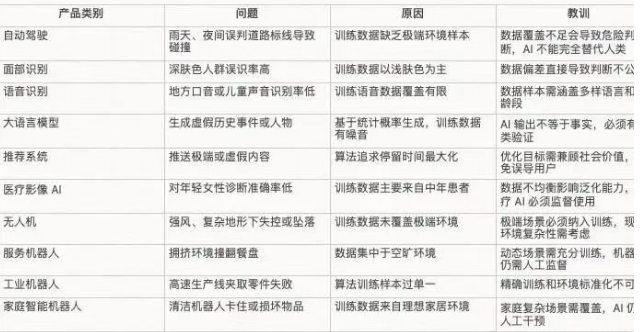

六、人工智障案例分析

总结:这些案例说明,无论技术多先进,AI 都可能出现“人工智障”,核心原因是数据、训练和算法设计不足。

七、公众理解 AI 的关键

能力与局限:AI 能做什么,不能做什么

数据决定结果:了解训练数据的质量、规模、偏差

算法理解:知道算法如何学习和应用数据

辅助而非替代:AI 是工具,决策仍需人类监督

风险意识:安全、伦理、偏差等潜在风险

八、总结与行动指南

数据决定结果:高质量、多样化数据是 AI 成功前提

算法决定处理方式:选择合适算法才能最大化数据价值

训练与验证不可忽视:影响 AI 的可靠性

理解 AI 逻辑、原理、局限与风险,理智使用 AI

人工智能不是魔法,它是一种工具。理解它的工作原理、局限和风险,是公众避免“人工智障”、合理利用AI 的第一步

本文内容仅供参考,不构成任何专业建议。使用本文提供的信息时,请自行判断并承担相应风险。