RAG如是怎么让AI精准回答问题的?

想象这样一个场景:你的公司开发了一款复杂的企业级软件,产品手册厚达500页。客户咨询问题时,你希望AI客服能快速给出准确答案。于是,你把整本手册塞给GPT-4,期待它能"过目不忘"。

结果呢?要么AI告诉你"上下文太长,无法处理",要么勉强运行但成本高得离谱,要么回答速度慢如蜗牛,甚至答非所问——因为它在500页的信息海洋中"迷路"了。

这就是企业在构建智能客服和知识库时面临的核心难题。而RAG技术,正是破解这一难题的关键钥匙。

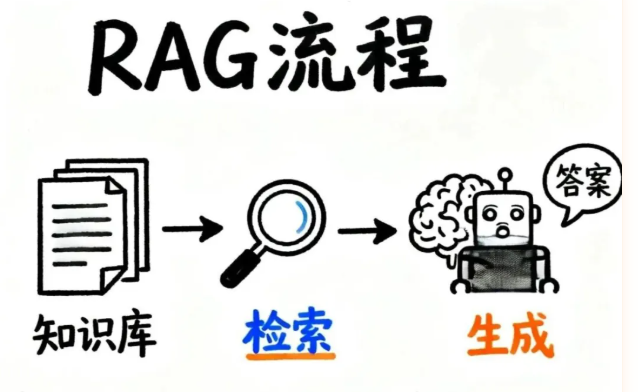

RAG是什么?用"检索"武装"生成"

RAG的全称是Retrieval Augmented Generation,翻译过来就是"检索增强生成"。拆解这个名字,你会发现它的核心逻辑非常直白:

- 检索(Retrieval):从知识库中找到与问题相关的内容

- 生成(Generation):基于检索到的内容生成答案

换句话说,RAG让AI在回答问题前先"翻书"——不是把整本书都读一遍,而是快速定位到相关章节,然后基于这几页内容给出精准答案。

这种"先检索再生成"的模式,彻底改变了AI处理企业知识的方式。

为什么不能直接把文档塞给大模型?

在深入RAG技术之前,我们需要理解:为什么直接把完整文档发给AI不可行?

痛点1:上下文窗口限制

每个大模型都有"记忆容量"限制,我们称之为上下文窗口。比如:

- GPT-4的上下文窗口是128K tokens(约10万字)

- 即使是最新的大模型,也难以有效处理超长文档

当你的产品手册有50万字时,模型要么直接拒绝处理,要么"读着读着就忘了前面的内容",导致答案质量直线下降。

痛点2:成本暴涨

大模型的计费方式是按输入tokens数量计算的。每次查询都发送500页手册,意味着:

- 单次对话成本可能高达数元甚至数十元

- 日均千次查询的企业,月成本可能高达数万元

这显然不是可持续的方案。

痛点3:速度堪忧

输入内容越多,模型处理时间越长。500页文档可能需要:

- 数十秒甚至数分钟才能开始输出

- 用户体验极差,完全无法满足实时客服场景

RAG的核心价值,就是把"全文检索"变成"精准提取"——只把真正相关的3-5个段落发给模型,将上述三个痛点同时击破。

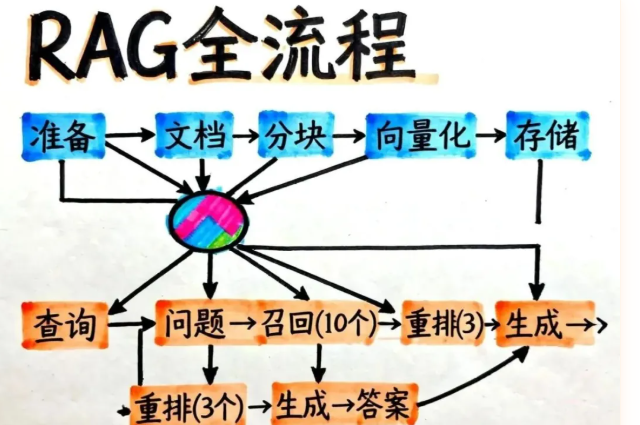

RAG的两大阶段:准备与响应

RAG的完整流程分为两个阶段,分别发生在用户提问之前和之后。

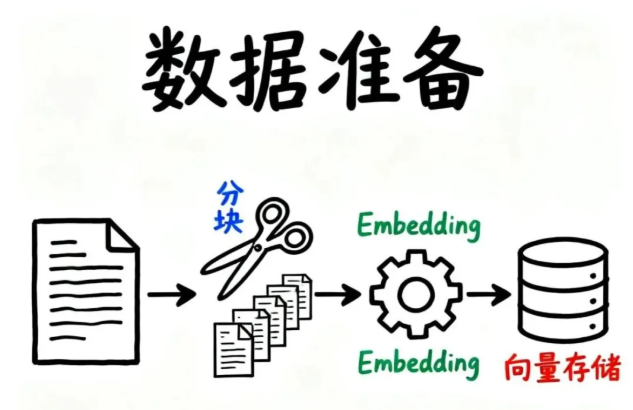

阶段一:数据准备(问题提出之前)

这个阶段的目标是建立知识库的"索引系统",包含两个关键步骤:

步骤1:分块(Chunking)

将长文档拆分成多个小段落。常见的分块策略包括:

- 按字数分块:每1000字一段

- 按段落分块:每个自然段作为一个块

- 按章节分块:按文档结构划分

- 按语义分块:保持语义完整性(更高级)

比如,500页的产品手册可能被拆分成500-1000个文本块。

步骤2:索引(Indexing)

这是RAG的"魔法时刻"。每个文本块会经历两个转换:

- Embedding转换:将文本块转换成向量(一串数字)

- 存储:将原始文本和对应向量一起存入向量数据库

这里需要解释三个关键概念:

向量(Vector):数学中的一个概念,可以用一组数字表示。比如:

- 一维向量:[3]

- 二维向量:[2, 2]

- 三维向量:[1, 2, 3]

在RAG中,我们使用的是高维向量(768维、1024维甚至更高)。虽然无法可视化,但它们能承载丰富的语义信息。

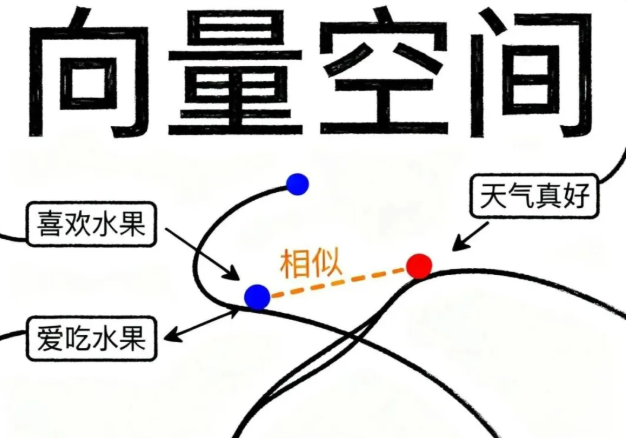

Embedding(嵌入):将文本转换成向量的过程。核心原理是:

- 语义相似的文本,转换后的向量也相似

- 比如"张三喜欢吃水果"和"张三爱吃水果"的向量会非常接近

- 而"天气真好"的向量则会离它们很远

这就像给每句话标注GPS坐标,相似的话在"语义地图"上距离很近。

向量数据库:专门用于存储和查询向量的数据库。它提供:

- 高效的向量存储优化

- 快速的相似度计算功能

- 同时存储原始文本和对应向量

典型的向量数据库表结构:

| 文本内容 | 向量 |

|---|---|

| 张三喜欢吃水果 | [0.2, 0.8, 0.1, …] |

| 天气真好 | [0.9, 0.1, 0.3, …] |

阶段二:查询响应(用户提问之后)

当用户提问后,系统会经历三个步骤来生成答案:

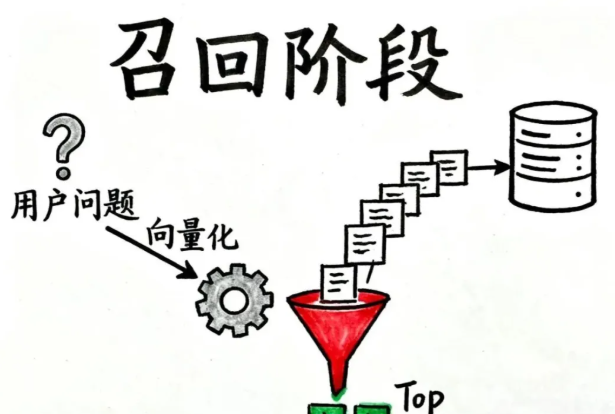

步骤1:召回(Recall)

目标:从海量文本块中快速筛选出最相关的候选集。

工作流程:

- 将用户问题通过Embedding模型转换成向量

- 在向量数据库中计算相似度,找出最相关的10个文本块(数量可调)

相似度计算方法包括:

- 余弦相似度:计算两个向量的夹角,角度越小越相似

- 欧氏距离:计算向量之间的直线距离,距离越短越相似

- 点积(Dot Product):综合考虑方向和长度,值越大越相似

召回阶段的特点是:速度快、成本低、精度相对较低。它的作用是从成千上万个候选中快速缩小范围。

步骤2:重排(Re-ranking)

目标:从召回的10个候选中,精确筛选出最优的3个文本块。

这里引入了一个更强大的模型:CrossEncoder。与召回阶段的向量相似度计算不同,CrossEncoder会:

- 将用户问题和每个候选文本块成对输入模型

- 让模型深度理解两者的语义关系

- 给出更精准的相关性评分

我们可以用企业招聘流程来类比召回和重排:

| 阶段 | 招聘类比 | RAG流程 | 特点 |

|---|---|---|---|

| 召回 | 简历筛选 | 向量相似度 | 快速粗筛,从1000份简历选10份 |

| 重排 | 面试评估 | CrossEncoder | 精细评估,从10人中选3人 |

简历筛选阶段,HR可能只看学历、工作年限等硬指标,速度快但可能漏掉好人才。而面试阶段,会深入考察候选人的实际能力,虽然耗时但精准度高。

为什么不直接在召回阶段就选3个? 因为CrossEncoder虽然精准,但计算成本高、耗时长。如果用它处理所有1000个文本块,系统会不堪重负。两阶段设计实现了效率与精度的最佳平衡。

步骤3:生成(Generation)

万事俱备,现在我们有:

- 用户的原始问题

- 3个高度相关的文本块

将它们一起发送给大模型(如GPT-4、DeepSeek),模型基于这些上下文生成最终答案。此时:

- 输入内容精简,成本低廉

- 信息高度相关,准确率高

- 处理速度快,用户体验好

完整流程串联:从文档到答案的旅程

让我们把所有环节串联起来,看一个完整的RAG问答过程:

数据准备阶段(问题提出前):

- 将500页产品手册拆分成800个文本块

- 每个文本块通过Embedding模型转换成768维向量

- 原始文本和向量一起存入向量数据库

查询响应阶段(用户提问后):

- 用户提问:“这款软件支持哪些操作系统?”

- 问题向量化:将问题转换成768维向量

- 召回:在800个文本块中,通过余弦相似度计算,找出最相关的10个

- 重排:用CrossEncoder对这10个候选精细评分,选出Top3

- 生成:将问题+3个文本块发给GPT-4,输出答案:“该软件支持Windows 10/11、macOS 12+以及Ubuntu 20.04+操作系统。”

整个过程耗时通常在1-3秒内,成本仅为直接发送完整文档的1/100甚至更低,而准确率却显著提升。

RAG的实战价值:企业智能化转型的基石

RAG技术已经在多个企业场景中展现出巨大价值:

1. 智能客服系统

- 处理产品咨询、技术支持、售后问题

- 24小时在线,响应速度<2秒

- 准确率可达95%以上(传统客服约80%)

2. 内部知识库

- 员工快速检索公司制度、技术文档、项目资料

- 新员工培训效率提升50%+

- 减少重复性咨询,释放HR和技术团队时间

3. 法律与合规助手

- 快速检索法规条文、合同模板、案例分析

- 辅助律师和合规团队提高工作效率

- 降低人工检索错误风险

4. 研发文档管理

- 快速查找API文档、设计规范、代码示例

- 新人上手速度提升3-5倍

- 减少重复造轮子现象

从"信息检索"到"知识智能"

RAG技术的本质,是让AI从"被动响应"转向"主动理解"。它不再是简单地匹配关键词,而是真正理解语义,找到用户真正需要的信息。

当前RAG技术仍在快速演进,行业正在探索:

- 混合检索:结合关键词检索和向量检索的优势

- 多模态RAG:不仅检索文本,还能检索图片、表格、图表

- 增量更新:知识库内容变化时,如何高效更新向量索引

- 多跳推理:处理需要多次检索才能回答的复杂问题

但方向已经明确:RAG是企业构建AI知识系统的标准范式。无论是客服机器人、内部知识库,还是专业领域助手,RAG都是不可或缺的技术基础。

掌握RAG,就是掌握了让AI真正"读懂"企业知识的能力。在数字化转型的浪潮中,这不是锦上添花,而是决定企业AI应用成败的关键一环。

本文内容仅供参考,不构成任何专业建议。使用本文提供的信息时,请自行判断并承担相应风险。