AI大模型多维突破,开源、具身、全模态全面开花

当11月的第一缕阳光照亮科技圈,AI大模型领域就掀起了一场"技术狂欢"。从开源模型的推理能力跃迁,到具身智能实现"机器人版ChatGPT时刻",再到全模态模型打破感知边界,短短7天内,行业呈现出开源化、实体化、多模态融合的多维突破态势。今天,我们就来深度拆解这波技术浪潮的核心亮点。

技术突破:开源模型扛起大旗,推理与效率双飞跃

本周最引人瞩目的莫过于开源大模型的集体爆发,尤其是月之暗面与华为云的联手,让"高性能+低成本"成为现实。

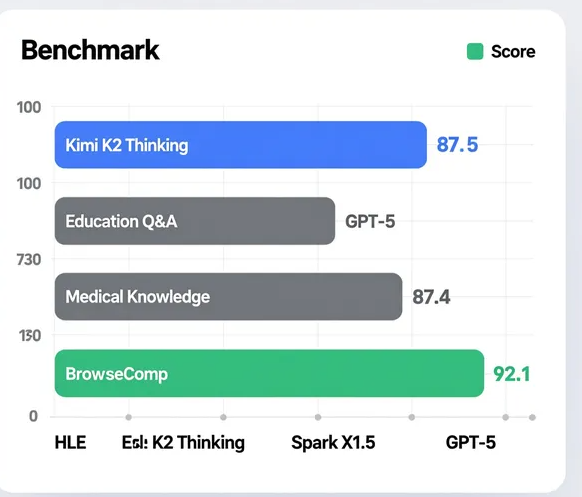

11月6日,月之暗面正式推出Kimi K2 Thinking开源模型,这款被称为"迄今能力最强的开源思考模型",在深度推理和Agentic能力上实现跨越式提升——支持200-300次连续工具调用无需人工干预,1TB总参数搭配32B激活参数,在人类最后的考试(HLE)、BrowseComp等权威基准测试中,直接刷新SOTA成绩,超越GPT-5、Claude Sonnet 4.5等闭源巨头。更关键的是,其采用最宽松的MIT协议开源,代码和权重已在Hugging Face上线,彻底降低了企业级应用的门槛。

而华为云的快速适配让这款强模型真正落地可期。依托CloudMatrix384超节点算力集群,华为云ModelArts推理平台实现三大优化:支持INT4量化格式部署,大幅降低能耗与显存占用;通过大EP专家并行、PD分离部署方案,结合全光互联网络提升推理速度;借助Flash Decode加速机制,让256K超长序列上下文处理更稳定高效。这意味着企业无需巨额算力投入,就能享受到顶尖模型的推理能力。

国内巨头科大讯飞也不甘示弱,推出深度推理大模型星火X1.5。基于全国产算力构建的MoE架构,293亿总参数量搭配30亿激活参数,单台昇腾标配服务器即可部署,推理效率较前代提升100%,端到端性能达到国际同类产品的93%以上。在教育、医疗领域的专项测试中,其表现更是超越GPT-5,教育模型平均得分突破85分大关。

具身智能:机器人迎来"觉醒时刻",从指令执行到自主决策

如果说基础模型是AI的"大脑",那么具身智能就是让大脑指挥"手脚"的关键。本周,机器人领域迎来两个里程碑事件,标志着其从"机械执行"迈向"自主思考"。

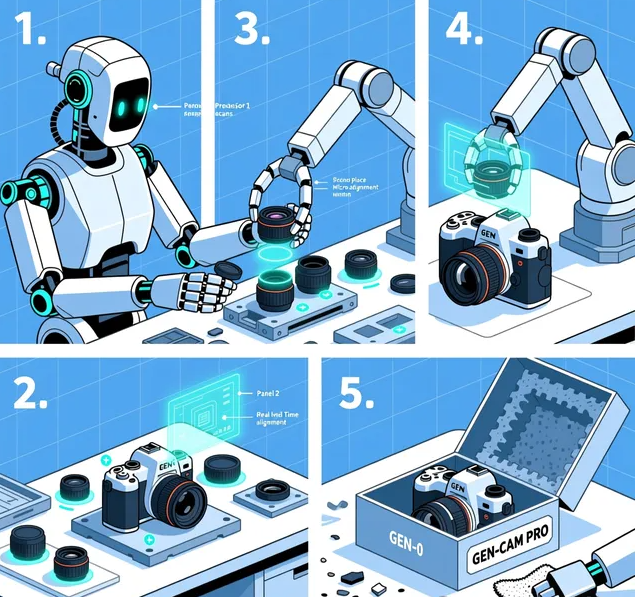

AI机器人初创公司Generalist发布的GEN-0模型,被业内称为"机器人版ChatGPT"。基于27万小时真实世界操作数据训练,首次提出具身智能缩放定律,同一模型可无缝部署于6自由度机械臂、半人形机器人等多种硬件。其核心的Harmonic Reasoning架构,解决了"思考与行动割裂"的行业痛点——通过异步连续时间流,让感知、推理、动作实时协同。演示中,机器人自主完成"组装相机套件"全流程,从折叠托盘到清理现场全程无人工干预,展现出极强的环境适应能力。

宇树科技的"Embodied Avatar"系统则让"人类分身"成为现实。用户佩戴动作捕捉设备后,全身23-43个关节数据通过5G实时传输至机器人,毫秒级响应同步复现拳击、舞蹈、精细操作等动作,最大关节扭矩达120N·m。依托自研UnifoLM大模型,机器人不仅能复刻动作,还能在新环境中自主微调姿态。该系统已规划工业巡检、远程医疗、元宇宙表演三大应用方向,未来加入触觉反馈后将进一步模糊虚拟与实体的边界。

全模态融合:英伟达开源新标杆,少数据实现高效果

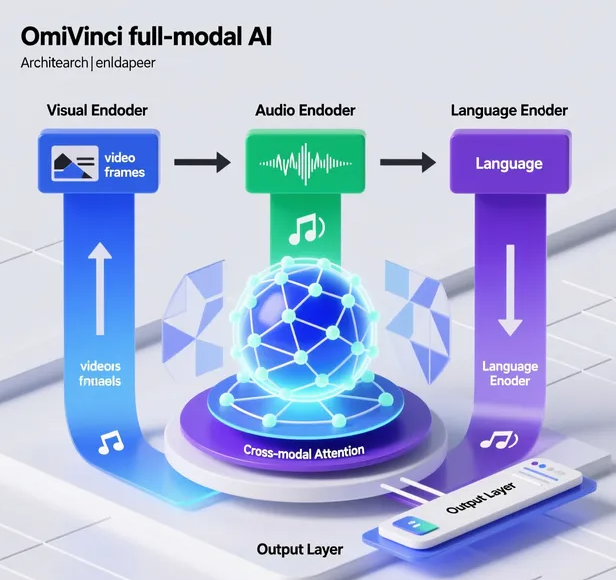

在多模态理解领域,英伟达本周抛出重磅炸弹——开源全模态大模型OmniVinci,上线一周Hugging Face下载量破万,成为行业新标杆。

这款9B参数模型的核心突破,是实现视觉、音频、语言在同一潜空间的统一理解,打破了传统多模态模型"各自为战"的局限。在DailyOmni、Video-MME等基准测试中,其视频-音频跨模态理解得分较竞品高出19.05分,视频理解得分高出3.9分。更令人惊叹的是,OmniVinci仅用近1/6的训练数据就实现超越,秘诀在于其创新的全模态数据引擎和学习方式:2400万条样本覆盖四大领域,通过"隐式学习"(利用视频自带音频数据)和"显式学习"(专用多模态标注数据)结合,大幅提升学习效率。

趋势总结:开源化+实体化+轻量化,AI落地加速

复盘本周动态,三大趋势已然清晰:一是开源成为技术普惠的核心力量,Kimi K2 Thinking、OmniVinci等开源模型让顶尖能力触手可及;二是具身智能从实验室走向实用化,GEN-0的缩放定律和宇树的分身系统,推动机器人在工业、医疗等领域的落地;三是轻量化部署成为刚需,INT4量化、MoE架构等技术让大模型摆脱"算力依赖"。

对于企业而言,本周的技术突破意味着AI落地的门槛大幅降低——无需自建大模型,通过华为云等平台调用开源模型,就能快速实现智能化升级;对于从业者来说,具身智能和全模态融合将成为新的技能风口。

本文内容仅供参考,不构成任何专业建议。使用本文提供的信息时,请自行判断并承担相应风险。